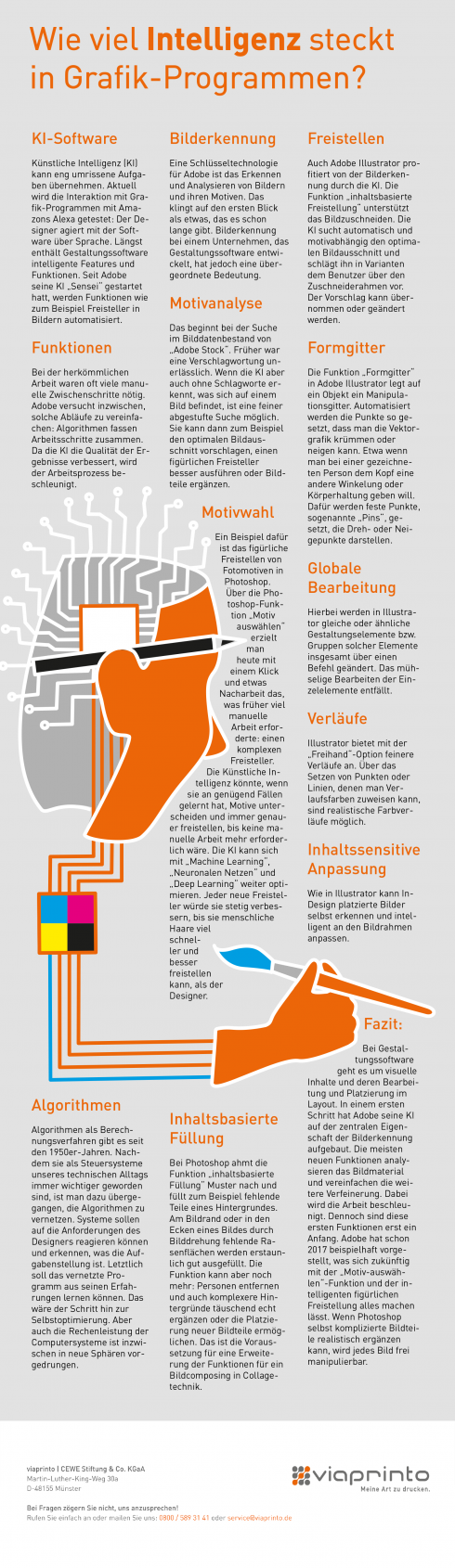

In Teil 1 unserer Reihe zur Künstlichen Intelligenz (KI) für Designer/innen und Medienschaffende ging es um den Rahmen von KI: Was sie ausmacht, welches Konzept hinter ihr steht und welche Arten von KI es gibt. Im 2. Teil geht es um die konkreten neuen Funktionen in der Gestaltungssoftware.

Künstliche Intelligenz: Was ist jetzt schon möglich?

KI kann bereits einige eng umrissene Aufgaben übernehmen. So wird etwa von Google getestet, dass die KI als Sprachassistent im Restaurant einen Tisch reserviert. Per Audio- oder Text-Chat beantwortet sie schon längst Fragen auf Webseiten. Die kleinen Helferlein, die dort eingesetzt werden, nennen sich Chatbots. Sie wurden mit einem Fundus möglicher Fragen und Antworten gefüttert, mit einem Wortschatz und dem Wissen über menschliche Interaktion im Kommunikationsprozess. Außerdem mit kommunikativen Verhaltensregeln. Dies wäre so ähnlich auch für die Interaktion mit einem Grafik-Programm vorstellbar: Der Designer sagt dem Programm, was es tun soll und agiert mit ihm über Sprache. Erste Versuche über Amazons Alexa und die Anbindung an eine Software laufen bereits.

Längst enthält auch Gestaltungssoftware als KI-Vorstufe intelligente Features und Funktionen. Seit Adobe seine KI „Sensei“ gestartet hat, hat sich das geändert. Nun optimiert eine KI Funktionen wie zum Beispiel Freisteller in Bildern. Dass das überhaupt möglich werden konnte, hat zwei Gründe.

Komplexität der Programmfunktionen

Die Programmpakete sind zunehmend komplexer geworden. Der Funktionsumfang etwa des aktuellen Photoshop ist mit dem der ersten Programmversionen nicht mehr zu vergleichen. Die Grafikprogramme quellen schier über vor Funktionalitäten, die immer unüberschaubarer werden. Sieht man sich Tutorials an, bemerkt man, dass für ausgefeilte Ergebnisse sehr viele manuelle Zwischenschritte notwendig sind. Adobe versucht inzwischen, solche Abläufe zu vereinfachen: Algorithmen sollen die Arbeitsschritte zusammenfassen. Da die KI die Qualität der Ergebnisse verbessert, sind sowieso weniger Zwischen- oder Korrekturschritte nötig. Die Notwendigkeit einer Beschleunigung des Arbeitsprozesses wird durch die KI Realität.

Die Technik ist soweit

Nicht nur können die Bildbearbeitungs- und Gestaltungsprogramme immer mehr, auch die Technik der Künstlichen Intelligenz ist weiter fortgeschritten. Algorithmen gibt es seit 300 v. Chr. Algorithmen wie sie heute in der digitalen Welt vorkommen, gibt es, seit es Programmierungen gibt, als verbreitete Anwendung seit den 1950er-Jahren. Dabei ist ein Algorithmus nichts anderes als ein Berechnungsverfahren, das sich innerhalb eines bestimmten Rahmens vollzieht. Es enthält Anweisungen und deren Abfolge für ein Problemlösungsverfahren. Man kann es sich als eine programmierte Bedienungsanleitung vorstellen. Nachdem Algorithmen als Steuersysteme unseres technischen Alltags immer wichtiger geworden sind, ist man dazu übergegangen, die Algorithmen zu vernetzen und Systeme zu erdenken, die reagieren können. Im Falle von Grafiksoftware müssen sie auf die Anforderungen des Designers reagieren können. Dabei sollen sie erkennen, was die Aufgabenstellung ist und eine Lösung dafür anbieten. Letztlich soll das vernetzte Programm aus seinen Erfahrungen lernen können. Das wäre der Schritt hin zur Selbstoptimierung. Aber auch die Rechenleistung der Computersysteme ist inzwischen in Sphären vorgedrungen, die vieles erst möglich macht.

Adobe, Affinity und QuarkXPress: Der Markt der Grafiksoftware

Adobe als Marktführer verfügt über einige sehr umfangreiche Programme wie Photoshop, InDesign und Illustrator, die wegen ihres Funktionsumfanges von Künstlicher Intelligenz profitieren können. Zudem verbindet Adobe auch sein Bildangebot über „Adobe Stock“ mit seiner Software. Auch „Adobe Fonts“ sind inzwischen im Abo enthalten. Stock-Fotos sind aus der Gestaltungssoftware hinaus aus der Cloud platzierbar. Schon bei der Bildersuche ist die KI behilflich.

Konkurrent QuarkXPress hat ein integriertes Programmpaket geschaffen, mit dem man nicht nur setzen und layouten kann, selbst die Generierung von Apps ist damit möglich. Anstatt eine Fülle an Programmen für die verschiedenen Aufgabenbereiche zu schaffen, geht Quark den Weg der Integration von Funktionen in einem Programmpaket und setzt dem teuren Abo-Modell von Adobe einen Einzelpreis entgegen.

Affinity mit seinen Programmen „Photo“ (vergleichbar mit Photoshop), „Designer“ (vergleichbar mit Illustrator) und „Publisher“ (vergleichbar mit InDesign) betreibt ein „Weniger-ist-mehr“. Die Programme sind schlank, schnell und über vergleichsweise geringe Einmalzahlungen preislich attraktiv.

Künstliche Intelligenz ist in der Softwarebranche zum Modewort geworden. Tatsächlich bringen in der Grafik-Software Übersichtlichkeit, durchdachte Funktionalitäten und kluge Algorithmen mitunter genug für einen schnellen Workflow – auch ohne KI. Affinity hat sich hier als kleine schnelle Konkurrenz zu Adobe etabliert. QuarkXPress kann auf seine lange Geschichte verweisen, durch die das Programm professionelle Funktionen etwa im Bereich der Typografie und für das Verlagspublishing bietet. Adobe positioniert sich als Zukunftsunternehmen, das seine Software „intelligent“ machen will. Es hat dabei einen einmaligen Software-Kosmos für alle Eventualitäten geschaffen, der allerdings auch bezahlt werden will. Denn das Abo-Modell ist insgesamt auf die Dauer teurer als der Programmkauf bei der Konkurrenz. Ob die KI als Verkaufsargument Adobes Position weiter festigen wird? Es wird darauf ankommen, ob der Nutzen sich fortwährend erhöht. Denn eine lernfähige KI würde sich laufend optimieren. Adobe wäre rein technisch über die Cloudanbindung seiner Nutzer dazu in der Lage, die Software aus den Millionen Aufgabenstellungen seiner Nutzer lernen zu lassen.

Bildanalyse als Kernkompetenz

Eine Schlüsseltechnologie für Adobe ist das Erkennen und Analysieren von Bildern und ihren Motiven. Das klingt auf den ersten Blick als etwas, das es schon lange gibt, etwa in Form der Gesichtserkennung. Allerdings hat Bilderkennung bei einem Unternehmen, das Gestaltungssoftware entwickelt, eine übergreifende Bedeutung.

- Motiverkennung: Das beginnt bei der Suche im Bilddatenbestand von Adobe Stock. Früher war eine Verschlagwortung unerlässlich, um ein passendes Motiv zu finden, etwa bei der Motivsuche „Pferd“. Wenn die KI aber auch ohne Schlagworte erkennt, was sich auf einem Bild befindet, ist eine feiner abgestufte Suche möglich, etwa: „Frau auf Pferd vor Landschaft“.

- Bildbearbeitung: Ist die KI aber erst in der Lage, Bildmotiviken zu erkennen, kann sie sie auch analysieren. Sie kann dann den optimalen Bildausschnitt vorschlagen, einen figürlichen Freisteller besser ausführen oder Bildteile ergänzen.

Welche KI-Design-Anwendungen gibt es?

Gemündet haben die bisherigen Bestrebungen von Adobe in Programmen, die dem Designer/der Designerin immer mehr Arbeit abnehmen und Design-Prozesse vereinfachen. Einige Beispiele:

Motiv auswählen in Photoshop

Ein Beispiel dafür ist das figürliche Freistellen von Fotomotiven in Photoshop. Über die Photoshop-Funktion “Motiv auswählen” (Auswahl > Motiv) erzielt man heute mit einem Klick und etwas Nacharbeit das, was früher viel mehr manuelle Arbeit erforderte: einen figürlichen Freisteller. Die Künstliche Intelligenz könnte, wenn sie an genügend Fällen gelernt hat, unterschiedlichste Motive unterscheiden und immer genauer freistellen, bis keine manuelle Arbeit mehr erforderlich wäre. Wie im ersten Teil unserer Serie zu lesen, kann sich die KI mit „Machine Learning“, „Neuronalen Netzen“ und „Deep Learning“ weiter selbst optimieren. Jeder neue Freisteller, mit dem man sie füttern würde, würde sie optimieren, bis sie menschliche Haare oder das Fell von Tieren viel schneller und viel besser freistellen kann, als es der Designer per Hand könnte.

Inhaltsbasierte Füllung in Photoshop

Bei Photoshop wurde die Funktion „inhaltsbasierte Füllung“ hin auf die Möglichkeiten der KI optimiert. Die Funktion ahmt Muster täuschend echt nach und füllt zum Beispiel fehlende Teile der Hintergrundmotivik. Etwa am Bildrand oder in den Ecken eines Bildes durch Bilddrehung fehlende Rasenflächen werden erstaunlich gut ausgefüllt. In der aktuellen Version mit Livevorschau können die Ursprungspixel gedreht oder skaliert werden, um die Musterergänzung zu optimieren. Dabei kann der von der Software ergänzte Teil auf eine eigene Ebene gelegt werden. Die Funktion kann aber noch viel mehr: zum Beispiel Personen entfernen und auch komplexere Hintergründe täuschend echt ergänzen oder die Platzierung neuer Bildteile ermöglichen. Das ist die Voraussetzung für eine Erweiterung der Funktionen für ein Bildcomposing in Collagetechnik. Ein Bild kann durch die intelligente Ergänzungsfunktion schnell und einfach geändert und ergänzt werden. Die Freistellfunktion zum Auswählen zu entfernender Bildteile korrespondiert damit.

Inhaltsbasierte Freistellung für den optimalen Bildzuschnitt in Illustrator

Auch Adobe Illustrator profitiert von der Bilderkennung durch die KI. Die Funktion „inhaltsbasierte Freistellung“ unterstützt das Bildzuschneiden. Die KI sucht automatisch und motivabhängig den optimalen Bildausschnitt und schlägt ihn in Varianten dem Benutzer über den Zuschneiderahmen vor. Der Vorschlag kann übernommen oder geändert werden.

Formgitter für das Verzerren von Grafiken in Adobe Illustrator

Die Funktion „Formgitter“ in Adobe Illustrator legt auf ein Objekt ein Manipulationsgitter. Automatisiert werden die Punkte so gesetzt, dass man die Vektorgrafik krümmen oder neigen kann. Etwa, wenn man bei einer gezeichneten Person dem Kopf eine andere Winklung oder Körperhaltung geben will. Dafür werden feste Punkte, sogenannte „Pins“, gesetzt, die Dreh- oder Neigepunkte darstellen. Solche Punkte lassen sich auch manuell löschen oder hinzufügen.

Layout anpassen in InDesign

In Adobe InDesign gibt es eine Funktion, die schon in Folge 1 unserer Serie genannt wurde und sich „Layout anpassen“ nennt. Mit ihr kann man die Gestaltungselemente, indem man ein paar Grundeinstellungen vornimmt, auf neue Formate oder Seitenränder automatisch anpassen. InDesign erledigt die Neupositionierung aller Elemente. Dies ist die Arbeit eines Algorithmus. Eine KI könnte dies weiter verfeinern und perfektionieren.

Weitere KI-gestützte Funktionen im Überblick

Globale Bearbeitung: Hierbei werden in Illustrator gleiche oder ähnliche Gestaltungselemente bzw. Gruppen solcher Elemente insgesamt über einen Befehl geändert. Das mühselige Bearbeiten der Einzelelemente entfällt.

Freihand-Verläufe: Illustrator bietet nun mit der „Freihand“-Option feinere und organische Verläufe an. Über das Setzen von Punkten oder Linien, denen man Verlaufsfarben zuweisen kann, ist eine neue Art von realistischen Farbverläufen möglich.

Inhaltssensitive Anpassung: Wie in Illustrator kann InDesign platzierte Bilder selbst erkennen und intelligent an den Bildrahmen anpassen.

Fazit: Bilderkennung als zentrales Element der KI

Bei Gestaltungssoftware geht es um visuelle Inhalte und deren Bearbeitung und Platzierung im Layout. In einem ersten Schritt hat Adobe seine KI „Sensei“ auf dieser zentralen Eigenschaft der Bilderkennung aufgebaut. Die meisten neuen Funktionen analysieren das Bildmaterial, selbst wenn es um Vektorgrafiken geht, und vereinfachen die weitere Verfeinerung. Dabei wird die Arbeit beschleunigt. Dennoch sind diese ersten Funktionen erst ein Anfang. Adobe hat schon 2017 beispielhaft vorgestellt, was sich zukünftig mit der „Motiv-auswählen“-Funktion und der intelligenten figürlichen Freistellung alles machen lässt. Wenn Photoshop selbst komplizierte Bildteile realistisch ergänzen kann, wird jedes Bild frei manipulierbar. Elemente lassen sich wegnehmen und hinzufügen, ohne dass man die Änderung hinterher sehen kann. Es wird zukünftig aber auf das Optimierungspotenzial der Software ankommen.